- RESOURCES -

Qwen2 技术报告(翻译)-CSDN博客

文章浏览阅读594次,点赞12次,收藏15次。随着ChatGPT(OpenAI, 2022)的出现,全球对大型语言模型(LLMs)的热情高涨。Llama系列(Touvron et al., 2023)的发布进一步点燃了开源社区的兴趣,特别是针对GPT级别的本地LLMs。最近,Claude-3 Opus(Anthropic, 2024)和GPT-4o(omni)(OpenAI, 2024),ChatGPT的更新模型,迅速攀升至Chatbot Arena(Chiang et al., 2024)的巅......

blog.csdn.net

阿里云发布全球最强开源模型Qwen2,性能超越众多中国闭源模型-潮起网

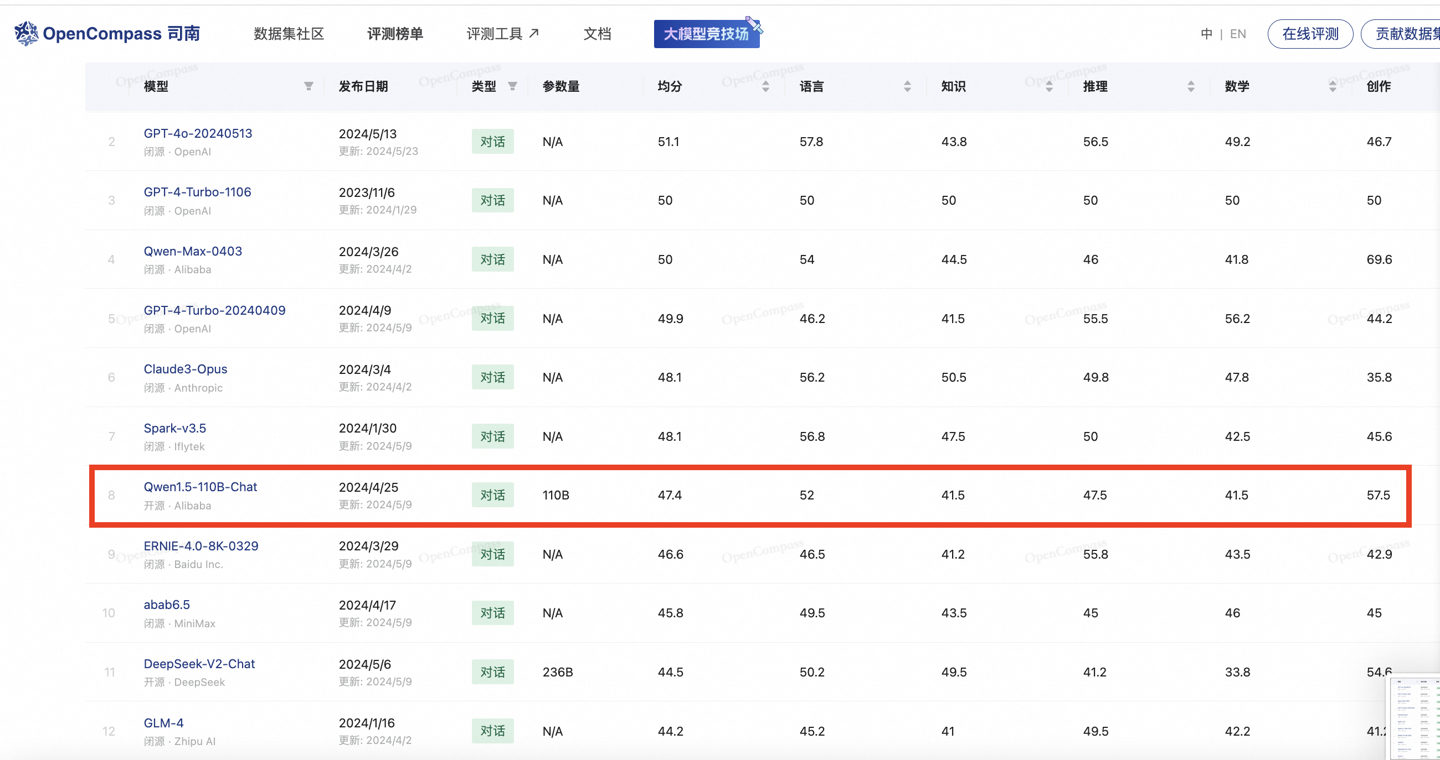

比中国闭源模型们更强的开源模型来了!6 月 7 日,阿里云更新技术博客:重磅发布全球性能最强的开源模型 Qwen2-72B,性能超过美国最强的开源模型 Llama3-70B,也超过文心 4.0、豆包 pro、混元 pro 等众多中国闭源大模......

www.ichaoqi.com

只需 30 分钟,微调 Qwen2-7B,搭建专属 AI 客服解决方案_qwen2-7b微调-CSDN博客

文章浏览阅读1.4k次,点赞26次,收藏11次。LLaMA-Factory 在data文件夹中提供了多个训练数据集示例,支持alpaca或sharegpt格式,不过我这里使用的是自己提前导出来做过处理的自定义数据集。1. 自定义数据集选用alpaca2. 因为我只有标注后的问答对,所以只需要填充和output部分即可,下面是部分数据,保存为 bajigo.json,并上传到 LLaMA-Factory 的 data 目录下。_qwen2-7b微调......

blog.csdn.net